最近、AI動画生成モデル「Seedance2.0」の注目度が急速に高まっています。

スピードと自然さを両立した出力品質が評価され、SNSでも話題になっています。

しかし一方で、「どこで使えるのか分からない」、「うまく出力できない」、「プロンプトの書き方が難しい」と感じている人も少なくありません。

実は、Seedance2.0(シードダンス2.0)は「感覚」ではなく「構造」で使うモデルです。

本記事では、初心者向けの基本操作から上級プロンプト設計まで、段階的に解説します。

Seedance2.0とは?

Seedance2.0は、中国ByteDanceが開発した新世代の多モーダル動画生成モデルです。

テキスト、画像、音声、動画を組み合わせて入力でき、動きの安定性・物理的リアルさ・原音との同期を重視しています。

実写・アニメの両方に対応しており、プロンプト次第で、高品質で思い通りの動画を生成できます。

Seedance2.0はどこで使える?

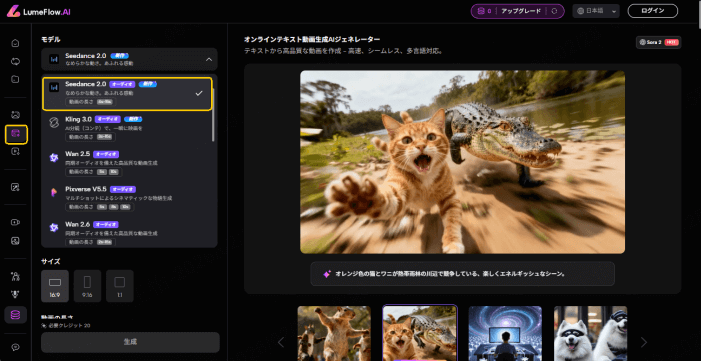

Seedance2.0は、主にオンラインプラットフォームを通じて利用できます。代表的なサービスとしては、LumeFlowAI、Dreamina、豆包などが挙げられます。

現在のところ、ローカル環境での直接実行には通常対応していません。ブラウザベースで動作するため、高性能GPUがなくても使用可能です。

現在公開されている主要な入口は以下の通りです。

テキスト・画像入力で動画生成、首尾フレームなど複数モードに対応

オールインワンのAI動画生成ツール

- モデルは随時更新。Seedance2.0・Kling3.0・Veo 3など最新モデルも利用可能

- 画像生成・動画生成の両方に対応した多機能AIツール

- 低コストでも高品質な動画作成が可能

- 日本語プロンプトに完全対応

- 商用利用OK。

- 専門知識不要、直感的に操作できるシンプルなUI

- プライバシーに配慮した制限の少ないサービス

全能参考・首尾フレームなどの生成モードを選択可能

中国ByteDance公式紹介ページ:機能説明と体験入口

豆包(Doubao):一部機能はグレード制、統合体験あり

小雲雀(XiaoYunQue/Little Skylark):剪映系AI創作アシスタントとして提供

火山エンジン( Volcengine):コンソール上で体験可能、公式事例も閲覧可能

注意点

各プラットフォームで使用できるモードや消費ポイント、生成可能時間、パラメータパネルの仕様は異なります。

また、グレードや地域設定により、アカウントによって全機能が利用できない場合があります。

Seedance2.0の使い方|初心者向けプロンプトの書き方

Seedance2.0で安定した動画を生成するには、プロンプトの構造が重要です。簡単に言うと、プロンプトは一文の感想や詩的表現ではなく、まるで映画の監督が作るコンテのように書くのがコツです。

ここでは、初心者でも安定して出力できる最小構造を紹介します。

主体 + 動作 + 場所/シーン + 時間・光線 + カメラ/視点 + スタイル・質感 + 画質 + 制約条件(ネガティブプロンプト)

この順序でプロンプトを組み立てると、思い通りの高品質な動画を生成しやすくなります。

下の動画は、上記の基本構造に沿って作成した例です。

では、この動画のプロンプトがどのように構成されているか、順番に見ていきましょう。

1主体誰が/何を映すのかを明確にします。

曖昧な表現は、生成結果が期待通りにならない原因になります。

例、短髪の日本女性がベージュのトレンチコートを着ている。

動作は単語だけでなく、流れとして記述します。

例、ゆっくりカメラに近づき、手で髪を整え、立ち止まって微笑む。そしてカメラに手を伸ばしながら、「あとで日が出るから、一緒に散歩に!」と言う。

背景を指定して映像の雰囲気を明確にします。

例、雨上がりの新幹線駅、路面に水たまりの反射。

時間帯や光の表現を指定し、映像の印象をコントロールします。

例、夕方のブルーアワー、柔らかい逆光、空気にわずかな霧。

カメラワークを指定すると映像の完成度が上がります。

例、中景でスタート、カメラは安定して追従、最後にクローズアップで顔に寄る。

映像のトーンや質感を整理します。

例、写実的な映画感、わずかな被写界深度、自然な肌色

画質やディテールも明確に指定します。

例、高解像度、テクスチャーやディテールを鮮明に。

不要な要素を排除し、生成の安定性を高めます。

例、動作が途切れない、顔が崩れない、画面がチラつかない、文字やウォーターマークを表示しない。

Seedance2.0では、ネガティブプロンプトの指定が特に重要です。

クリックしてプロンプト例を表示。コピーして、そのまま同じ動画を生成してみましょう。

Seedance2.0の使い方|構造を理解して上級者レベルへ

ここからは、シードダンス2.0で映像の完成度を一段引き上げる実践テクニックを紹介します。

1 動作は「連続したプロセス」で書く

Seedance2.0では、単発の動作よりも流れとして記述するほうが安定した動画生成が可能です。 単語だけで「歩く」「踊る」と書くと、モデルが補完を乱すことがあります。

-

ゆっくり振り向き、歩き出し、カメラを見て、呼吸を整えて立ち止まる。

-

踊る(抽象的すぎると、モデルが自由に生成する)

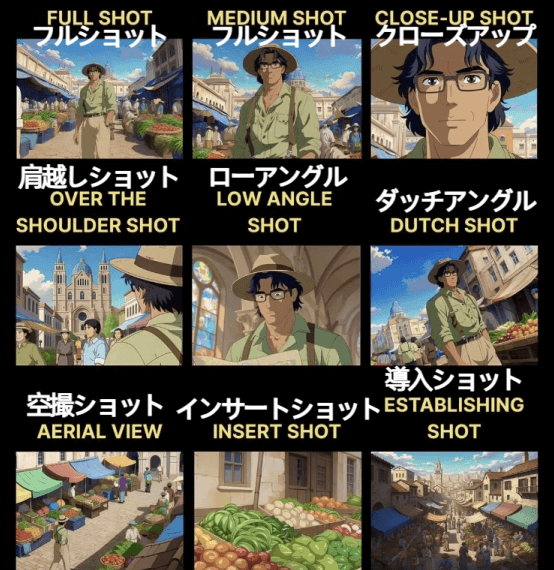

2 映像の質は「カメラ言語」で決まる

Seedance2.0で映像のクオリティを安定させるには、カメラワーク(カメラ言語)の指定が重要です。初心者はまず、安定して生成できる基本のカメラ動作を優先しましょう。

-

平穏な追従撮影

-

ゆっくり前進(スムーズなパン)

-

軽く半周回る追従

-

固定カメラ(製品や静物向け)

-

激しい振り回し

-

急速パン

-

超長回転ショット

3 まずは「主体を一つ」に絞る

Seedance2.0は複数の人物やアクションも生成可能ですが、初心者はまず一つの主体に絞るのが安定です。複雑な群像やバトルは、コストが高く、失敗しやすいため注意してください。

4 スタイルは盛らない

Seedance2.0では、映画感+写実+超高解像度+史詩級のように多くのスタイルを詰め込みすぎると、逆に干渉して映像が不自然になることがあります。

基本ルール:主となるスタイルを1つ選び、質感や雰囲気の補助語を1~2個加えるだけで十分です。

-

写実的な映画感 + 浅い被写界深度 + 柔らかい粒子感

-

アニメ風 + きれいな線 + 高彩度

5 ネガティブプロンプトが品質を安定させる

Seedance2.0では、生成で避けたい要素を明確に書くネガティブプロンプトが、品質を安定させる重要なポイントです。

-

顔の崩れや変形を防ぐ

-

指の多指・欠損を防ぐ

-

動作の途切れや抽搐を防ぐ

-

画面のチラつきを防ぐ

-

字幕・文字・ウォーターマーク・ロゴを表示させない

Seedance2.0で最も実用的な2つの生成モード

シードダンス2.0は、従来の動画生成モデルと比べて、運動の安定性や物理的リアリティ、音画同期などが大きく進化しており、初心者でも扱いやすく高品質な動画生成が可能です。ここでは、特に実用性の高い2つの生成モードを紹介します。

1 テキストから動画生成

特徴:シードダンス2.0の完全創作向けモードです。プロンプトの構造設計がそのまま結果に反映され、自由度が高い分、プロンプト精度が重要です。生成速度も最速です。

適用シーン:感情的なカット、雰囲気のあるショット、短編ストーリーのオープニングなど。

ポイント: プロンプトは細かく書き、ネガティブプロンプトなど制約条件も明確に設定すると、安定して高品質な動画を生成できます。

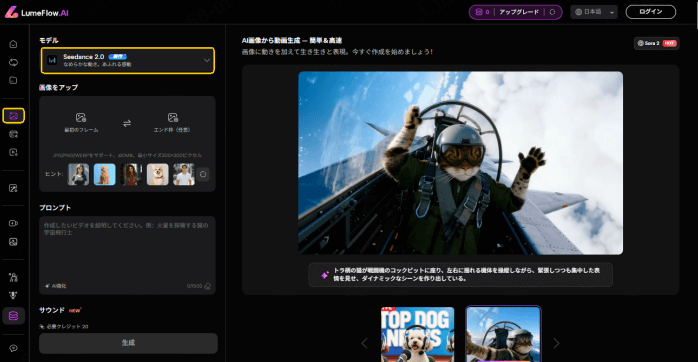

2 画像から動画生成

特徴: 本モデルでは、既存キャラクターや人物を自然に動かせます。キャラクター固定や表情変化が自然で、二次元キャラ生成にも適しており、初心者でも扱いやすい安定モードです。

適用シーン: 人物の外見・服装・構図を固定したい場合に最適です。

ポイント: 参考画像が生成の上限を決め、プロンプトが動作やカメラワークを制御します。

Seedance2.0に関するよくある質問(FAQ)

Seedance2.0はいつリリースされた?

2026年2月12日に正式リリースされた。

Seedance2.0の料金はいくら?

Seedance2.0の料金は利用するプラットフォームによって異なります。Lumeflowでの料金プランについては、 こちらからご確認ください。 Lumeflowでは最新のSeedance2.0に加え、Nanobanana 2やKling 3.0など、複数の人気モデルも利用可能です。

シードダンス2.0はアニメ生成に強い?

実写寄りの表現に強い傾向がありますが、プロンプト次第でアニメ調も安定して生成可能です。

Seedance2.0はローカル環境で使える?

現在、Seedance2.0はローカル環境での実行には対応していません。

まとめ

Seedance2.0の強みは、想像力ではなく監督のような制御力にあり、プロンプトをコンテのように書くことで、実写に近い映像を生成できます。プロンプトの構造を理解し、短尺動画で練習しながら段階的に構造を固めることで、初心者でも安定して高品質な動画を作ることが可能です。

なお、シードダンス2.0を手軽に試すなら、LumeFlow AIがおすすめです。日本語UIで分かりやすく、操作も簡単、性価比も高いため、入門から応用まで安心して活用できます。Lumeflowを使いながら、自分なりの構造を試して動画制作に挑戦してみましょう。